Microsoftは4月23日、小型言語モデル(SLM)となる「Phi-3」モデルを発表しました。

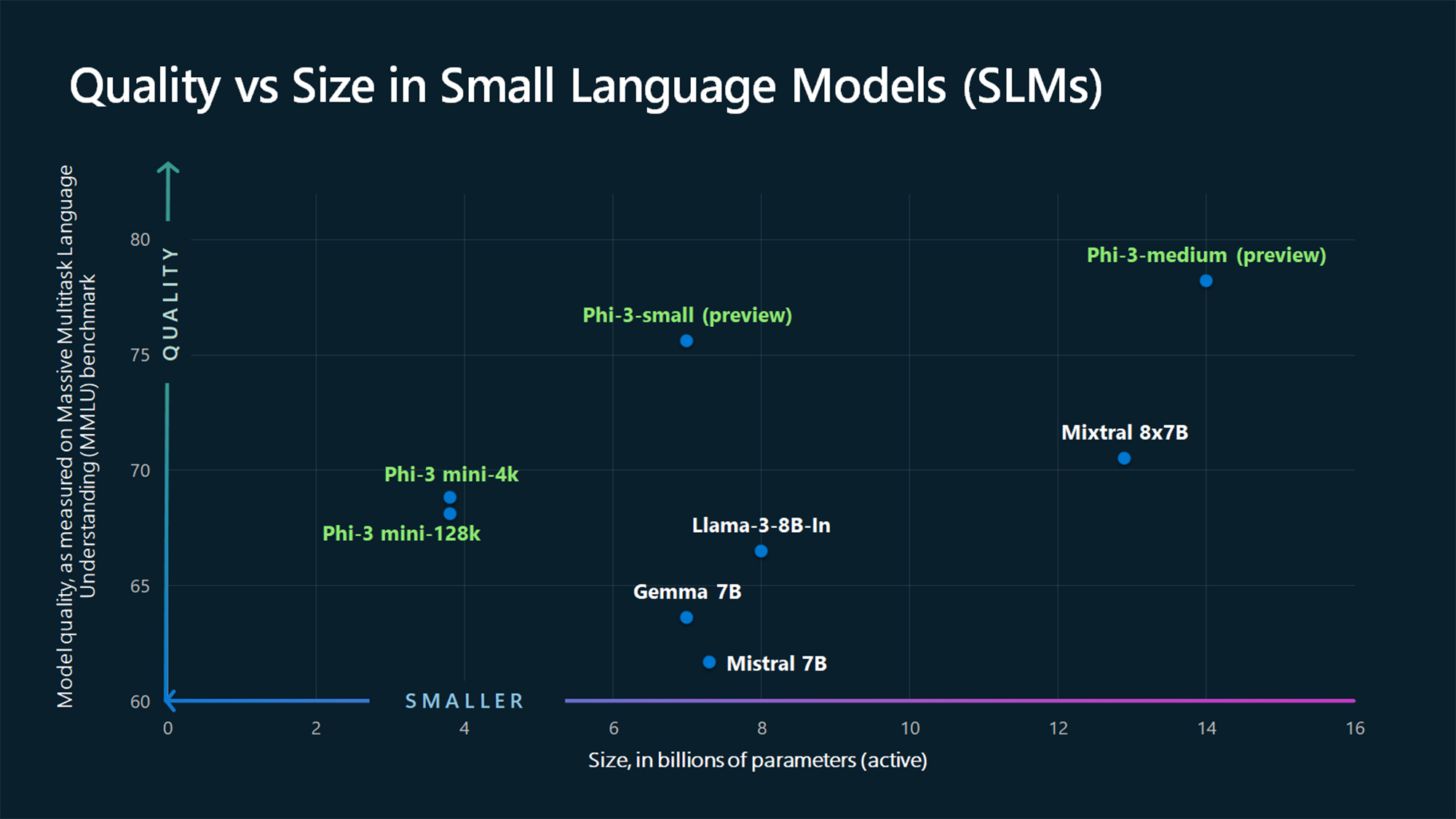

Microsoftは「Phi-3」について、同等あるいはそれ以上のモデルよりも、言語やコーディング、数学の能力を評価するさまざまなベンチマークにおいて、大幅に優れたパフォーマンスを示すとしており、高機能でコスト効率の高い小型言語モデルと説明しています。

また、「Phi-3」ファミリーの初めてのモデルとなる「Phi-3-mini」も発表。38億個のパラメータを持つ「Phi-3-mini」には、4Kトークンと 128Kトークンのコンテキスト長が用意されており、2倍のサイズのモデルよりも優れたパフォーマンスを発揮するようです。「Phi-3-mini」はMicrosoft Azure AI Studio、Hugging Face、およびOllamaで利用することができます。

「Phi-3」ファミリーには、他にも70 億パラメーターを持つ「Phi-3-small」と140 億パラメーターを持つ「Phi-3-medium」が追加され、Azure AIモデルカタログおよびその他のモデルガーデンで間もなく利用可能になります。

「Phi-3」モデルのような小規模言語モデルは、オフライン環境での利用やリソースに制限のあるオンデバイスでの利用、高速な応答速度によるユーザーエクスペリエンスの向上、プライバシーへの配慮などにおいて有効な選択肢になるため、Vargas氏とYadav氏は、クラウドに接続されていないスマートフォンやその他のモバイル端末、自動車のコンピュータ、交通システム、工場現場のスマートセンサー、リモートカメラにデータを保持することで、遅延を最小限に抑え、プライバシーを最大限に高めることができると述べています。

Source:https://news.microsoft.com/source/features/ai/the-phi-3-small-language-models-with-big-potential/

Source(日本語):https://news.microsoft.com/ja-jp/2024/04/24/240424-the-phi-3-small-language-models-with-big-potential/